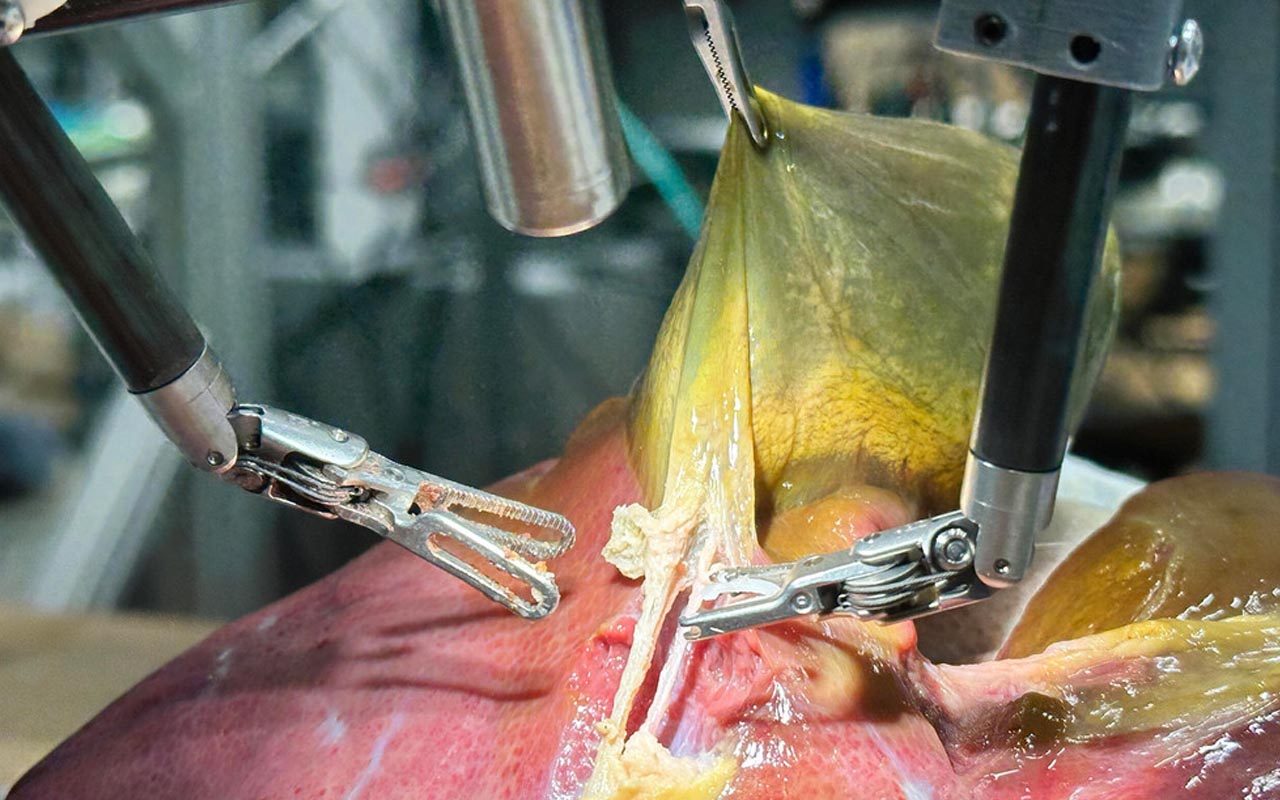

La herramienta será probada en situaciones reales por un grupo de investigadores.

Para combatir a las fake news producidas por imágenes, audios o videos generados con inteligencia artificial, la empresa detrás de ChatGPT -OpenAI- está desarrollando una herramienta para detectar contenido falso, aparentemente realista, creado por su popular generador de imágenes, DALL-E. No obstante, la compañía tecnológica advierte que esta herramienta es solo un primer esfuerzo de lo que será necesario para luchar contra los denominados ‘deepfakes’ en los próximos meses y años.

En los últimos años, el auge de los modelos generativos de IA también ha implicado la proliferación de deepfakes generados por IA, pornografía no consentida e infracciones de derechos de autor.

El pasado martes, OpenAI indicó que compartiría su nuevo detector de falsificaciones con un pequeño grupo de investigadores de desinformación para que pudieran probar la herramienta en situaciones del mundo real y ayudar a identificar formas en que podría mejorarse. Este anuncio fue confirmado a The New York Times por Sandhini Agarwal, investigadora de OpenAI centrada en seguridad y políticas, quien destacó la urgencia de implementar esta medida.

OpenAI aseguró que su nuevo detector podría identificar correctamente el 98,8 % de las imágenes creadas por DALL-E 3, la última versión de su sistema de inteligencia artificial que genera imágenes y arte realistas a partir de una descripción en lenguaje natural. Pero la compañía aclaró que la herramienta no fue diseñada para detectar imágenes producidas por otros generadores populares como Midjourney y Stability.

Además, dado que se basa en probabilidades, este tipo de detector de deepfake nunca podrá ser perfecto. Por ello, como muchas otras empresas, organizaciones sin fines de lucro y laboratorios académicos, OpenAI está trabajando para combatir el problema de otras maneras.

La investigadora de OpenAI, Sandhini Agarwal, indicó a The New York Times que el nuevo detector de falsificaciones de OpenAI puede ayudar a solucionar el problema, pero no lo resolverá, pues en la lucha contra los deepfakes “no existe una solución milagrosa”.

Etiquetas para contenido generado con inteligencia artificial

Al igual que los gigantes tecnológicos Google y Meta, la compañía se unirá al comité directivo de la Coalición para la Procedencia y Autenticidad del Contenido, o C2PA, en un esfuerzo para desarrollar credenciales para contenido digital. El estándar C2PA es un protocolo universal para etiquetar imágenes, videos, clips de audio y otros archivos que muestra cuándo y cómo fueron producidos o alterados, incluso con inteligencia artificial (IA).

OpenAI también señaló que está desarrollando formas de insertar marcas de agua en los sonidos y píxeles de imágenes generados por IA para que puedan identificarse fácilmente en el momento. La empresa espera que estas marcas de agua sean difíciles de eliminar.

Otros esfuerzos de la lucha contra el deepfake

Google anunció, en agosto de 2023, que los usuarios tendrían más facilidades para solicitar la eliminación de cualquier imagen personal sexualmente explícita que se haya publicado sin su consentimiento en la web, de modo que ya no aparecerá en los resultados de búsquedas de Google. Esto incluye contenido generado con inteligencia artificial.

Además, en YouTube y otros servicios de Google está prohibido publicar contenido que incluya representaciones de genitales, pechos o glúteos (cubiertos o descubiertos), así como pornografía, representaciones de actos sexuales o fetichismo. Esta actualización aplica para el contenido creado por terceros que se encuentre activo, pero también si el propietario del sitio web eliminó la publicación.

Ese mismo mes, Google lanzó la herramienta SynthID, desarrollada por Google DeepMind, que agrega una marca de agua imperceptible directamente en los píxeles de las nuevas imágenes. Esta herramienta solo estuvo disponible inicialmente para los usuarios de Imagen, su generador de imágenes de inteligencia artificial (IA) alojado en Vertex, la plataforma de aprendizaje automático de Google Cloud.

Con esta herramienta, los usuarios pueden generar imágenes en Imagen y elegir si quieren añadir una marca de agua o no. El objetivo es proteger los derechos de autor y ayudar a la gente a identificar un contenido generado por IA que se hace pasar por real.

Por otro lado, el generador de imágenes Meta AI ayuda a los usuarios a crear ilustraciones y fotos con simples indicaciones de texto. Para apostar por la transparencia, Meta incluirá una etiqueta que confirma que la imagen fue creada con IA en los post publicados en sus redes sociales: Facebook, Instagram y Threads.

La etiqueta «Imaginado con IA» será agregada automáticamente a las imágenes fotorrealistas creadas con Meta AI, pero próximamente se espera hacerlo también con los contenidos creados con herramientas de otras empresas.

Meta fue claro en advertir que aún no es posible identificar todos los contenidos generados por IA. Para ello, Meta —la empresa matriz de Facebook, Instagram y Threads— sumará socios del sector para desarrollar estándares técnicos comunes que indiquen cuándo un contenido se ha creado con IA.

La detección de estas señales permitirá etiquetar las imágenes generadas por IA que los usuarios publiquen en Facebook, Instagram y Threads.

Meta empezará a etiquetar contenidos generados por IA en mayo de 2024, y en julio dejarán de eliminar contenidos basados únicamente en su política de videos manipulados.